이 회사가 이렇게 AI시장을 주도할지 누가 알았을까요? 5년전만 해도 고사양게임 하려면 필요한 Graphic card 업체로 알고있었습니다. 5년전 즈음해서 Deep Learning을 하는데 CPU power보다는 core가 많은 GPU power를 고려하는 프로젝트를 하면서 NVidia가 무슨 일을 벌이는가를 인지하게 되었습니다.

당시에 알게된 것은 CUDA(Compute Unified Device Architecture)를 통해서 NVidia GPU의 성능을 활용하여 병렬 컴퓨팅 처리를 할 수 있게하는 Toolkit과 프로그램 모델을 제공하는 것이 핵심 차별점이었습니다. 예를들면, 단지 HW만 제공하는 것이 아니라, 유전체역학을 모델링하여 렌더링할 수 있는 프로그램 모델을 제공해 주는 것입니다.

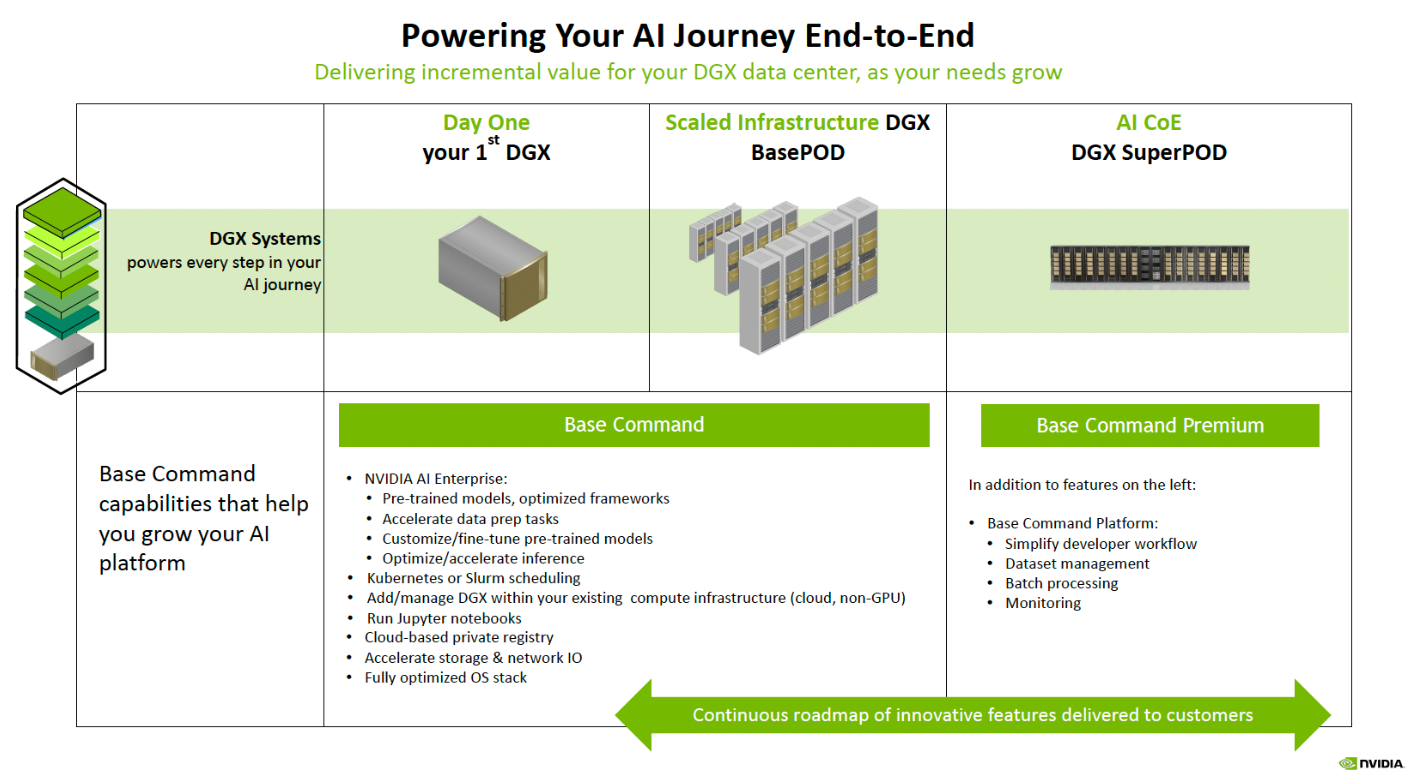

본 posting에서는 DGX, HGX, SuperPods에 대한 용어를 정리하려고 합니다.

DGX는 NVidia에서 설계한 시스템으로 딥 러닝 모델의 훈련 및 배포 프로세스를 가속화하도록 설계된 특수 목적의 AI 슈퍼컴퓨터입니다. 8장의 GPU가 장착되어 고성능 처리가 필요하므로, HPC서버 스펙에 좋은 cooling, 고전력을 소화할 수 있는 제품입니다. 핵심은 최신의 GPU와 설계를 반영한 NVidia에 제품인 것이죠.

HGX는 일종의 reference architecture입니다. 개별 HW vendor에게 이 참조 아키텍쳐를 주고, 그들이 custom한 제품을 만들고, 이를 NVidia가 certification을 해주는 것입니다. 즉, GPU card나 핵심 부품은 같을 수 있으나 설계를 하면서 전력이나 온도에 대한 마진 등은 각 vendor의 역량으로 제공되는 것입니다. 여담으로 DGX/HGX 다 써보신 고객 중에 NVidia의 서버 품질과 지원에 불만이 있어서 HGX를 사용하신다는 feedback을 주신 분도 있었습니다.

두제품의 차이는 일단 가격이 HGX가 저렴합니다. 다만, 최신 DGX에서 사용되는 GPU모델을 일정 시기가 지나야(이전 세대) HGX에서 탑재할 수 있기 때문에 최신 모델을 쓰려면 DGX가 유일한 선택지입니다. 또한, GPU를 4장만 탑재한 버전처럼 custom 버전은 HGX만 구매 가능하다고 합니다.

SuperPods는 AI 개발을 협업하는 큰 규모에서는 DGX 한대로 프로젝트를 진행하는 것이 아닌 수십대가 필요한데, 이런 곳에서 대량의 DGX를 deploy해서 제공하며, 그것을 운용하는데 필요한 도구들을 제공해 줍니다. SuperPod는 20대부터 시작해서 140노드까지 확장이 가능합니다. (DGX A100 기준)

'Things that inspire me' 카테고리의 다른 글

| [유머] 삼성전자 반도체의 굴욕 (0) | 2023.10.07 |

|---|---|

| James Webb(제임스 웹) 우주 망원경 이야기 - 언노운: 우주를 보는 타임머신 (0) | 2023.09.12 |

| HBM 고대역폭 초고속 메모리 (High-Bandwidth Memory) (0) | 2023.08.31 |

| PCI Express gen5 (0) | 2023.02.26 |

| 고성능 네트워크 연결 기술 - InfiniBand (0) | 2023.02.26 |